Definitivamente, acredito que a inteligência artificial (IA) é uma ferramenta que, se usada de maneira criteriosa, pode dar superpoderes aos profissionais de saúde ao colocar as informações certas na ponta de seus dedos, nos momentos que realmente importam para eles e seus pacientes. No entanto, também acredito que, para cumprir essa promessa, devemos focar, primeiramente, nas pessoas e depois na tecnologia.

Em conversas com líderes de saúde em todo o mundo, um desafio que normalmente surge é a dificuldade de encontrar médicos especializados em número suficiente para atender à crescente necessidade de atendimento. Nesse ponto, gostaria de perguntar: e se pudéssemos tornar seus médicos duas vezes mais eficazes e eficientes, permitindo-lhes tomar melhores decisões, enquanto passam mais tempo com os pacientes?

Essa é essencialmente a promessa da IA, seja por meio da automação de tarefas ordinárias, que tiram o foco do médico sobre o paciente, seja pelo suporte à decisão clínica nos momentos que, em última análise, pode-se de chegar a melhores desfechos de saúde.

Apesar de todos os seus avanços tecnológicos, surpreendentemente, poucas aplicações de IA conseguiram transpor as barreiras do laboratório de pesquisa para a prática clínica. O que está atravancando a adoção da IA na área da saúde?

Superando os entraves à adoção da IA

Problemas relacionados à gestão de dados e interoperabilidade são frequentemente retratados como os principais gargalos para uma adoção mais ampla da IA – e por um bom motivo. Na agitada e estressante realidade do dia-a-dia dos profissionais médicos, no entanto, há outros fatores em jogo também. Fatores humanos.

Os médicos costumam trabalhar com uma agenda apertada, dependentes das rotinas construídas ao longo dos anos de experiência. Se a IA não se encaixar perfeitamente em seus fluxos de trabalho, ou pior, se criar complexidade adicional, os médicos terão dificuldade em aceitá-la. E em um ambiente de alto risco como o de saúde, em que os profissionais precisam tomar decisões instantâneas com consequências de longo alcance, pode ser difícil desenvolver confiança em novas tecnologias. Você confiaria na recomendação de um algoritmo quando a vida de um paciente estivesse em suas mãos? Tanto o ajuste inadequado do fluxo de trabalho quanto a falta de confiança têm mostrado dificultar a aceitação da IA [1,2].

Inovações anteriores em saúde enfrentaram alguns dos mesmos desafios de adoção. Basta lembrar dos Prontuários Médicos Eletrônicos (PEP). Originalmente apresentado como o futuro da saúde, agora, é amplamente reconhecido que os PEP não foram suficientemente projetados de acordo com as necessidades e experiências dos médicos, com os profissionais lamentando que estão “presos atrás de suas telas” [3, 4]. Dessa vez, com a IA alimentando a próxima onda de inovação digital, devemos aprender com os erros do passado e adotar uma abordagem radicalmente diferente, que coloca as pessoas na frente e no centro. Não como uma reflexão tardia, mas desde o início.

Médicos e IA: a nova equipe médica ampliada

A saúde precisa de IA centrada no ser humano: inteligência artificial que não seja apenas impulsionada pelo que é tecnicamente viável, mas, acima de tudo, pelo que é humanamente desejável. Isso significa que precisamos combinar ciência de dados e conhecimento técnico com um forte entendimento do contexto clínico no qual os médicos atuam, bem como das demandas cognitivas e emocionais de sua realidade diária.

Pensar nos médicos e na IA como um sistema colaborativo é essencial aqui. Embora a IA possa superar cada vez mais os médicos em tarefas específicas, essa mesma IA e o conhecimento clínico profundo precisam andar de mãos dadas, porque ambos têm seus pontos fortes e limitações únicos. Conseguir essa relação complementar, de forma adequada, é o que acabará por determinar a adoção e o impacto da IA na saúde.

A saúde precisa de IA centrada no ser humano: inteligência artificial que não seja apenas impulsionada pelo que é tecnicamente viável, mas, acima de tudo, pelo que é humanamente desejável.

Já vemos os primeiros contornos da colaboração indivíduos-IA em radiologia; uma disciplina que sempre esteve na vanguarda da transformação digital em saúde e que, agora, é um viveiro fértil para inovação em IA. Com radiologistas e equipes de imagem escassos em muitas partes do mundo, enfrentando cargas de trabalho cada vez maiores, certamente poderiam se beneficiar de um assistente digital inteligente.

Mas como podemos garantir que a IA complemente esses especialistas humanos de forma que, juntos, alcancem mais do que qualquer um deles sozinho? Claramente, a resposta não vai se apresentar em uma bandeja de prata se nos concentrarmos na tecnologia de forma isolada.

Há muito tempo, acredito que, para entregar inovação significativa às pessoas, é preciso inovar com elas, e não para elas. Como argumentei na conferência Fortune Brainstorm Design, há algum tempo, construir algoritmos nos confins de um laboratório de pesquisa em si não nos trará IA centrada no ser humano. Em vez disso, devemos primeiro agir no sentido de submergir-nos na realidade diária das pessoas cujas vidas estamos tentando melhorar.

É exatamente isso que estamos fazendo com nossos parceiros clínicos e acadêmicos, como o Catharina Hospital e a Eindhoven University of Technology (como parte de nossa colaboração conjunta denominada e/MTIC [i]) e o Leiden University Medical Center na Holanda, conduzindo análises de fluxo de trabalho de 360 graus no local e sessões de cocriação com especialistas médicos para olhar além da tecnologia em si e compreender o contexto completo de uso.

Por meio desse trabalho, estamos começando a descobrir os geradores de experiências que promovem uma forte colaboração médico-IA em radiologia. E o que se tornou bastante claro é que projetar uma IA centrada no ser humano envolve muito mais do que criar uma interface de usuário superior.

O que é tecnicamente possível pode não ser o que é realmente necessário

Antes de mais nada, precisamos nos perguntar: que tipo de IA seria útil em primeiro lugar? Esta parece ser uma questão óbvia, mas as aplicações de IA, muitas vezes, falham em traduzir-se para a prática clínica precisamente, porque a necessidade subjacente ou o ponto de dor foi mal definido.

Por exemplo, se um algoritmo de análise de imagem é meramente capaz de identificar anormalidades que um radiologista pode detectar rapidamente, seu valor agregado pode ser limitado, apesar de seu forte desempenho técnico. Ou digamos que haja um algoritmo que ajuda a medir o tamanho do tumor: pode ser um pouco mais preciso do que um observador humano, mas se a diferença for tão pequena que não afete praticamente as decisões de tratamento, não há benefício real para o paciente.

Em vez disso, se adotarmos uma visão do pensamento sistêmico, partindo das necessidades do radiologista e de outras partes interessadas no fluxo de trabalho de radiologia, incluindo o paciente e o técnico de radiologia que realiza o exame, podemos identificar oportunidades em que a IA terá maior valor agregado. Isso podem se dar em qualquer estágio do fluxo de trabalho.

Por exemplo, no início do fluxo de trabalho, a IA pode ajudar a otimizar os agendamentos para que os pacientes sejam atendidos o mais rápido possível. Ou pode auxiliar os técnicos de radiologia na seleção e preparação dos exames de imagem apropriados para um paciente específico para evitar novas varreduras desnecessárias. Uma vez que as imagens tenham sido adquiridas, a IA pode apoiar os radiologistas de várias maneiras, por exemplo, apontando-os para descobertas incidentais que são fáceis de ignorar ou economizando tempo, por meio da integração automática das descobertas no laudo.

Há muitos outros casos de uso em que podemos pensar, alguns dos quais estamos explorando ativamente com nossos parceiros clínicos. Identificar pontos problemáticos e mapear oportunidades ao longo de todo o fluxo de trabalho é uma ótima maneira de lançar um programa de inovação de IA, porque cria um foco compartilhado no valor que a IA pode agregar em cada etapa.

A IA deve ser parte integrante do fluxo de trabalho

Embora definir o valor agregado pretendido da IA seja um ponto de partida vital, é a maneira como a IA se encaixa no fluxo de trabalho – e pode, em última instância, ajudar a simplificá-lo – que fará ou interromperá a adoção na prática clínica.

Algo que aprendemos por meio de nossas colaborações com parceiros de radiologia é que o que pode parecer uma aplicação útil no papel, pode, na verdade, ser um fardo para o radiologista, se parecer “adicionar mais uma etapa” ao seu fluxo de trabalho. Os radiologistas trabalham em um ambiente complexo e pressionado pelo tempo, executando diferentes aplicativos de software em paralelo e em várias telas. É por isso que é realmente importante incorporarmos aplicativos de IA em suas soluções de imagem e informática existentes, tornando as informações facilmente disponíveis na ponta dos dedos, em vez de adicionar uma colcha de retalhos de soluções pontuais.

Mas devemos pensar ainda mais holisticamente sobre a integração do fluxo de trabalho, olhando para o sistema de diagnóstico em geral. Por exemplo, a IA poderia fazer uma análise preliminar da tomografia computadorizada de um paciente para sinalizar casos preocupantes que requerem acompanhamento imediato com PET-CT. Em si, esta seria uma aplicação muito útil. Só funcionaria, no entanto, se fosse possível disponibilizar espaço na agenda do PET-CT nesse mesmo dia, o que apresenta um novo desafio de fluxo de trabalho (um que a IA também pode ser capaz de suportar). Como mostra esse exemplo, é preciso olhar para a forma de trabalho de todo o hospital, não apenas os elementos individuais do fluxo de trabalho.

A IA deve inspirar confiança adequada que corresponda às suas capacidades

Outro desafio de design apresentado pela IA, ao qual mencionei antes, é fazer com que os médicos confiem em seus resultados e recomendações. Com o surgimento do deep learning, os sistemas de IA se tornaram muito mais precisos e poderosos – mas também se tornaram cada vez mais difíceis de interpretar, exigindo do usuário um salto de fé. A confiança é essencial para a adoção, mas difícil de ser conquistada. A confiança também é facilmente perdida quando o sistema de IA fornece recomendações erradas, mesmo que mantenha um desempenho altamente preciso na média.

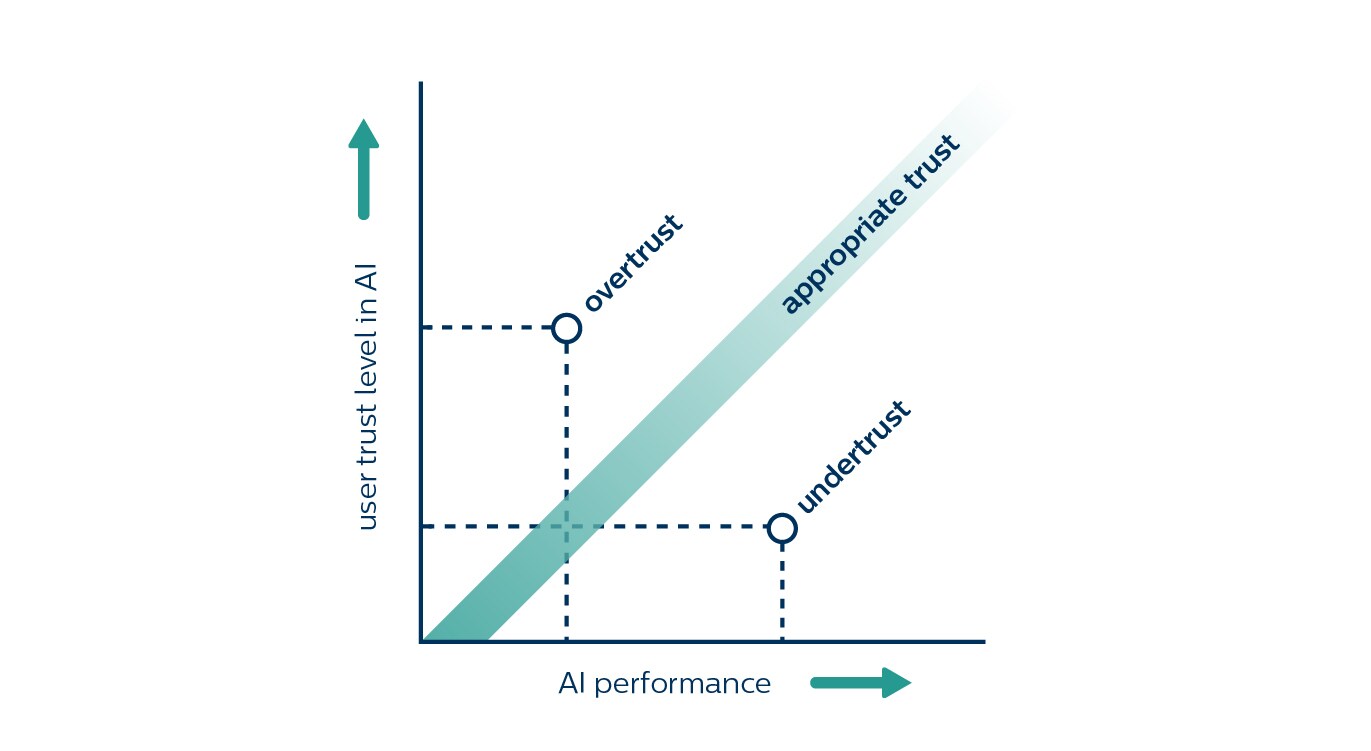

E o mais complicado é que, quando se trata de confiança, também pode haver “coisas boas demais”. Não queremos que um radiologista siga cegamente as descobertas de um algoritmo, quando o algoritmo, às vezes, não detecta uma doença. O que queremos é a confiança na medida adequada, que corresponda às capacidades da IA. Isso significa navegar por uma linha tênue entre falta de confiança e excesso de confiança.

A falta de confiança ocorre quando a confiança fica aquém das capacidades reais da IA. Vários estudos mostraram que já radiologistas negligenciaram pequenos cânceres identificados pela IA [5,6]. Por outro lado, o excesso de confiança leva ao excesso de dependência na IA, fazendo com que os radiologistas não percebam os cânceres que a IA não conseguiu identificar [7].

Como ajudar os radiologistas a encontrarem o equilíbrio certo entre confiança e vigilância?

Primeiro, é essencial que entendam o que um sistema de IA pode e não pode fazer, em quais dados foi educado e para que foi otimizado. Por exemplo, um algoritmo pode ser otimizado para detectar pequenos tumores nos pulmões, mas pode, portanto, ignorar os maiores. Isso não é nada intuitivo para o radiologista e requer comunicação ativa para evitar a quebra de confiança. Os radiologistas também vão querer saber o quão bem a IA faz o que deveria fazer, pedindo transparência em sua validação e desempenho.

Além disso, precisamos considerar como podemos tornar as descobertas da IA tão compreensíveis quanto possível e necessárias. Embora a interpretação possa não ser tão importante quando os riscos são baixos, em uma situação de alto risco, a natureza da caixa preta de um sistema de IA pode ser um impedimento para a confiança. Junto com nossos colaboradores clínicos e parceiros acadêmicos, como a Eindhoven University of Technology, estamos investigando várias maneiras de abordar esse problema – seja explicando a filosofia de design da IA em geral ou fornecendo a justificativa para recomendações individuais.

Colocando as pessoas em primeiro lugar

É claro que as percepções dos médicos sobre a IA continuarão a evoluir à medida que suas capacidades amadurecem. Assim como um residente calouro que se soma à uma equipe médica, a IA precisa demonstrar seu valor agregado e ganhar confiança com o tempo.

Com a IA como um colaborador confiável que está perfeitamente integrado ao fluxo de trabalho, os radiologistas ficarão livres de tarefas rotineiras e poderão dedicar mais tempo a casos complexos, aumentando seu impacto na tomada de decisões clínicas. Os profissionais de saúde em outras áreas da medicina também se beneficiarão cada vez mais com a assistência da IA – seja em patologia digital, tratamento intensivo, terapia guiada por imagem ou manejo de doenças crônicas. Acredito firmemente que isso tornará seu trabalho mais valioso e gratifica.

Como eu esperava mostrar, esse futuro não acontecerá sozinho. Só acontecerá por conta do design.

Os designers devem ter um papel ativo desde o início do desenvolvimento da IA, trabalhando ao lado de cientistas de dados, engenheiros e especialistas clínicos para criar experiências habilitadas para IA que façam uma diferença positiva para profissionais de saúde e pacientes.

Só então veremos a IA na área da saúde cumprir totalmente sua promessa; se colocarmos as pessoas, não a tecnologia, em primeiro lugar.

Observação

[i] O e/MTIC ou Eindhoven MedTech Innovation Center é uma colaboração de pesquisa entre a Eindhoven University of Technology, o Catharina Hospital, o Maxima Medical Center, o Kempenhaeghe Epilepsy and Sleep Center e a Philips.

Referências

[1] Christopher J. Kelly, Alan Karthikesalingam, Mustafa Suleyman, Greg Corrado, and Dominic King. 2019. Key challenges for delivering clinical impact with artificial intelligence. BMC Medicine 17, 1: 195. https://doi.org/10.1186/s12916-019-1426-2

[2] Lea Strohm, Charisma Hehakaya, Erik R. Ranschaert, Wouter P. C. Boon, and Ellen H. M. Moors. 2020. Implementation of artificial intelligence (AI) applications in radiology: hindering and facilitating factors. European Radiology. https://doi.org/10.1007/s00330-020-06946-y

[3] Atul Gawande. 2018. Why doctors hate their computers. New Yorker. https://www.newyorker.com/magazine/2018/11/12/why-doctors-hate-their-computers

[4] Robert M. Wachter. 2015. The digital doctor: hope, hype, and harm at the dawn of medicine’s computer age.

[5] D. W. De Boo, M. Prokop, M. Uffmann, B. van Ginneken, and C. M. Schaefer-Prokop. 2009. Computer-aided detection (CAD) of lung nodules and small tumours on chest radiographs. European Journal of Radiology 72, 2: 218–225. https://doi.org/10.1016/j.ejrad.2009.05.062

[6] Robert M. Nishikawa, Alexandra Edwards, Robert A. Schmidt, John Papaioannou, and Michael N. Linver. 2006. Can radiologists recognize that a computer has identified cancers that they have overlooked? In Medical Imaging 2006: Image Perception, Observer Performance, and Technology Assessment, 614601. https://doi.org/10.1117/12.656351

[7] W. Jorritsma, F. Cnossen, and P. M. A. van Ooijen. 2015. Improving the radiologist–CAD interaction: designing for appropriate trust. Clinical Radiology 70, 2: 115–122. https://doi.org/10.1016/j.crad.2014.09.017

[8] John D. Lee and Katrina A. See. 2004. Trust in automation: designing for appropriate reliance. Human Factors 46, 1: 50-80. https://doi.org/10.1518/hfes.46.1.50_30392

Compartilhe nas redes sociais

Temas

Autor

Sean Carney

Former Chief Experience Design Officer at Royal Philips from 2011 to 2022