Na medida em que a inteligência artificial (IA) começa a fazer parte do setor da saúde, questões referentes ao uso ético e responsável da tecnologia assumem importância no debate. Até que ponto podemos confiar em algoritmos de IA quando se trata de questões de vida ou morte, ou de saúde pessoal e bem-estar? Como podemos garantir que esses algoritmos sejam usados apenas para os propósitos pretendidos? E como garantir que a IA não discrimine inadvertidamente culturas específicas, minorias ou outros grupos, perpetuando assim as desigualdades de acesso e da qualidade dos cuidados médicos? Essas perguntas são muito importantes para serem respondidas em retrospectiva. São questionamentos que nos obrigam a pensar de forma proativa – como setor e como atores individuais – sobre como podemos melhor promover a IA na saúde e na vida saudável em benefício de consumidores, pacientes e profissionais de saúde, evitando consequências não intencionais.

Como podemos melhor promover a IA na saúde e na vida saudável em benefício das pessoas, evitando consequências não intencionais?

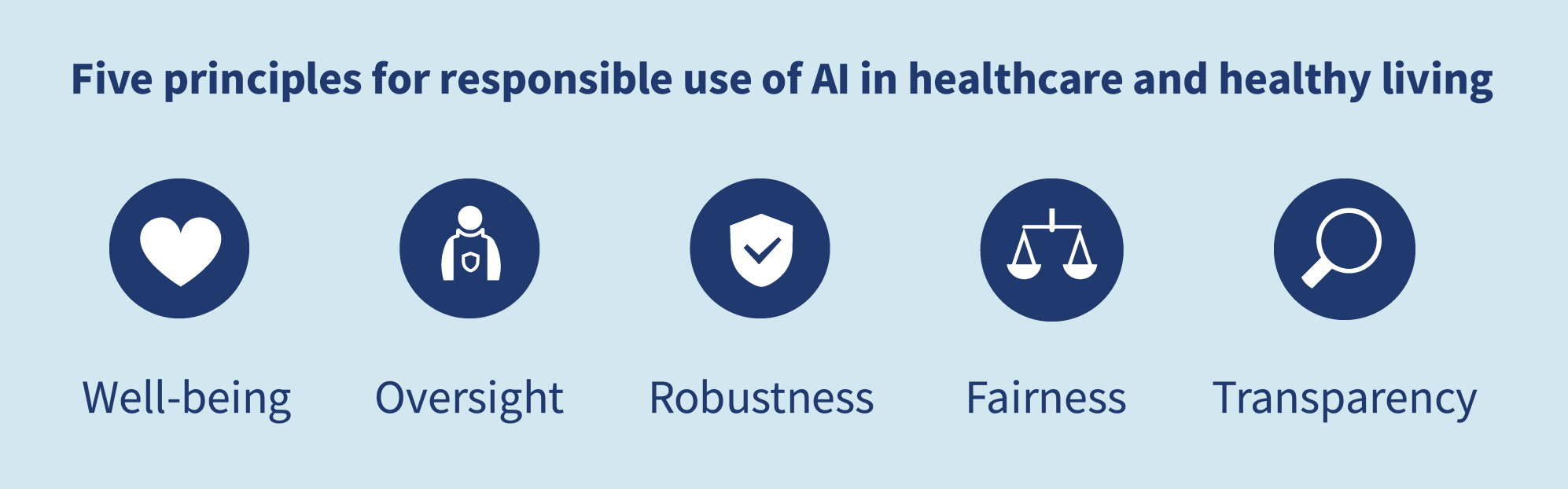

Como a IA em aplicações do setor da saúde e de saúde pessoal muitas vezes envolve o uso de dados pessoais confidenciais, uma prioridade fundamental é, obviamente, usar esses dados de forma responsável. Os dados devem ser mantidos seguros e protegidos em todos os momentos e processados de acordo com todas as regulamentações de privacidade relevantes. Na Philips, capturamos isso em nossos Princípios de Dados. No entanto, como a IA está prestes a mudar fundamentalmente a maneira como as pessoas interagem com a tecnologia e tomam decisões, são necessárias novas normas e salvaguardas. As políticas de dados por si só não são suficientes. Isso nos levou a desenvolver um conjunto de cinco princípios orientadores para o design e o uso responsável da IA em aplicações do setor da saúde e de saúde pessoal – tudo baseado na noção essencial de que as soluções habilitadas para IA devem complementar e beneficiar clientes, pacientes e a sociedade como um todo.

O que cada um desses princípios implica e por que eles são tão importantes?

1. Bem-estar

As soluções habilitadas para IA devem beneficiar a saúde e o bem-estar dos indivíduos e contribuir para o desenvolvimento sustentável da sociedade. Como em qualquer inovação tecnológica, em primeiro lugar devemos nos perguntar qual propósito humano a IA deve servir. O objetivo não deve ser promover a IA como um fim em si mesmo, mas sim melhorar o bem-estar e a qualidade de vida das pessoas. Com o aumento da demanda global por cuidados de saúde e a crescente escassez de profissionais do setor, há uma clara necessidade de IA para ajudar a aliviar a sobrecarga dos sistemas de saúde. Muito já foi escrito sobre como a IA pode atuar como um assistente inteligente para os profissionais de saúde no diagnóstico e tratamento – tudo com potencial para melhorar os resultados de saúde a um custo menor, ao mesmo tempo em que qualifica a experiência da equipe e do paciente (conhecido como o Objetivo Quádruplo). Mas para realmente beneficiar a saúde e o bem-estar das pessoas para as próximas gerações, precisamos pensar além do modelo atual reativo que visa “cuidar da doença”. Com a IA, podemos avançar em direção a um verdadeiro e proativo cuidado da saúde. A cada passo na vida das pessoas – do berço à velhice –, os aplicativos e serviços de saúde alimentados por IA poderiam informar e apoiar um estilo de vida saudável com assistência e aconselhamento personalizados, prevenindo e tratando doenças.

Com a IA, podemos passar do modelo reativo de cuidar da doença para um cuidado proativo da saúde.

Isso não deve ser o privilégio de um grupo restrito de pessoas. Em consonância com os Objetivos de Desenvolvimento Sustentável da ONU, acredito que devemos adotar uma abordagem inclusiva que promova o acesso ao cuidado e à vida saudável para todos. Em muitos países em desenvolvimento hoje, existem grandes desigualdades entre os serviços de saúde urbanos e rurais. Combinada com outras tecnologias poderosas, como a Internet das Coisas, e tecnologias de telecomunicações de banda larga, como o 5G, a IA poderia ajudar a reduzir essas desigualdades, disponibilizando conhecimento médico especializado em áreas rurais [1].

2. Supervisão

As soluções habilitadas para IA devem aumentar e capacitar as pessoas, com supervisão adequada. Agora que estabelecemos o bem-estar humano como o propósito norteador para o desenvolvimento da IA, como garantir que a IA cumpra esse objetivo? Como já defendi no passado, a IA aumenta as habilidades humanas e a experiência, mas não as torna menos relevantes. Especialmente no complexo mundo da saúde, onde as vidas estão em jogo, ferramentas de IA como o aprendizado de máquina exigem conhecimento e experiência do domínio humano para contextualizar seus resultados. Um exemplo clássico da literatura médica pode ajudar a ilustrar isso – mostrando o que poderia dar errado se confiássemos cegamente nos algoritmos. Em meados dos anos 90, uma equipe de pesquisa multi-institucional criou um modelo de aprendizado de máquina para prever a probabilidade de morte para pacientes com pneumonia. O objetivo era garantir que pacientes de alto risco fossem internados no hospital, enquanto pacientes de baixo risco poderiam ser tratados em ambulatórios. Com base nos dados de treinamento, o modelo inferiu que pacientes com pneumonia com histórico de asma têm menor risco de morrer de pneumonia do que a população em geral – um achado que vai contra todo o conhecimento médico comum [2]. Sem uma compreensão mais profunda dos dados, isso poderia ter levado à conclusão errônea de que pacientes com histórico de asma não precisavam de cuidados hospitalares com tanta urgência. Mas isso não poderia estar mais longe da verdade. O que realmente explicou o padrão nos dados é que pacientes com histórico de asma geralmente eram internados diretamente na UTI quando apresentavam pneumonia no hospital. Isso reduzia o risco de morte por pneumonia em relação à população em geral. Se eles não tivessem recebido um atendimento tão proativo, eles teriam de fato um risco muito maior de morrer. Não havia nada de errado com o modelo de aprendizado de máquina em si – mas a correlação que havia sido identificada com base no conjunto de dados de treinamento era perigosamente enganosa. Este exemplo mostra como é crucial que o poder de cálculo da IA ande de mãos dadas com o conhecimento de especialistas humanos e da ciência clínica estabelecida. Não se pode usar um sem o outro.

O poder de cálculo da IA deve andar de mãos dadas com o conhecimento de especialistas humanos e da ciência clínica estabelecida.

Na pesquisa médica, portanto, é essencial reunir engenheiros de IA, cientistas de dados e especialistas clínicos. Isso ajuda a garantir a validação e interpretação adequadas dos insights gerados pela IA. Depois que uma aplicação de IA foi adotada na prática clínica, ela pode ser uma poderosa ferramenta de suporte a decisões – mas ainda requer supervisão humana. Suas descobertas e recomendações precisam ser avaliadas ou verificadas por um médico, de acordo com uma compreensão holística do contexto do paciente.

3. Robustez

As soluções habilitadas para IA não devem fazer mal e devem ter proteção adequada contra uso indevido deliberado ou inadvertido. Para promover a aplicação responsável da IA, também precisamos implementar salvaguardas para evitar o uso indevido ou deliberado não intencional. Ter um conjunto robusto de mecanismos de controle ajudará a estabelecer confiança, ao mesmo tempo em que mitiga riscos potenciais. Isso é particularmente importante porque o uso indevido pode ser sutil e até mesmo ocorrer inadvertidamente – com a melhor das intenções. Por exemplo, digamos que um algoritmo é desenvolvido para ajudar a detecção de câncer de pulmão usando tomografias de baixa dose. Se o algoritmo se mostrar eficaz para essa aplicação, com uma alta sensibilidade para detectar possíveis sinais de câncer de pulmão, pode parecer óbvio estender seu uso também para uma configuração de diagnóstico. Mas para uso eficaz e confiável nesse cenário, o algoritmo pode precisar ser ajustado de forma diferente, com maior especificidade de forma a descartar pessoas que realmente não tenham câncer de pulmão. Inclusive, um algoritmo totalmente diferente poderia ter um desempenho melhor. Diferentes configurações, diferentes demandas. Uma forma de prevenir o uso indevido (inadvertido) é monitorar o desempenho de soluções habilitadas para IA na prática clínica – e comparar os resultados reais com os obtidos em treinamento e validação. Qualquer discrepância significativa geraria uma análise adicional. O treinamento e a educação também podem ser muitos úteis em garantir o uso adequado da IA. É fundamental que todo usuário tenha uma compreensão profunda das vantagens e limitações de uma solução específica habilitada para IA.

4. Equidade

As soluções habilitadas para IA devem ser desenvolvidas e validadas com dados representativos do grupo visado para o uso pretendido e, ao mesmo tempo, evitar o preconceito e a discriminação. Outra prioridade é garantir que a IA seja igualitária e livre de preconceitos. Devemos estar cientes de que a IA é tão objetiva quanto os dados que alimentamos nela. Um viés poderia ser facilmente inserido se um algoritmo fosse desenvolvido e treinado com base em um subconjunto específico da população, para depois ser aplicado a uma população mais ampla. Tome Dissecção Espontânea da Artéria Coronária (SCAD), uma condição rara e muitas vezes fatal que causa uma ruptura em um vaso sanguíneo do coração. Oitenta porcento dos casos de SCAD envolvem mulheres, mas as mulheres são tipicamente sub-representadas em ensaios clínicos que investigam a SCAD [3]. Se desenvolvermos uma ferramenta de apoio à decisão clínica alimentada por IA com base em dados desses ensaios clínicos, ela aprenderia com dados predominantemente masculinos. Como resultado, a ferramenta pode não capturar totalmente a complexidade da doença nas mulheres – perpetuando o viés que já estava presente nos ensaios. Riscos semelhantes surgem quando um algoritmo de IA é desenvolvido em uma região do mundo e, em seguida, aplicado em outra região sem que antes seja feita uma revalidação com dados locais. Por exemplo, doenças cardiovasculares normalmente afetam pessoas da Índia 10 anos antes do que as pessoas de ascendência europeia [4]. Portanto, se um algoritmo for treinado apenas para os europeus, ele pode não captar sinais precoces de doenças cardiovasculares em pessoas indianos. Como evitar esses vieses? Em primeiro lugar, o desenvolvimento e a validação da IA devem ser baseados em dados que representam de forma precisa a diversidade de pessoas no grupo-alvo. Quando a IA é aplicada a um grupo-alvo diferente, ela deve antes ser revalidada – e possivelmente retreinada.

O desenvolvimento e a validação da IA devem ser baseados em dados que representam de forma precisa a diversidade de pessoas no grupo-alvo.

Pela minha experiência na Philips, ter uma organização diversificada – com equipes de pesquisa na China, EUA, Índia e Europa – também ajuda a criar consciência da importância da equidade na IA. A diversidade promove uma mentalidade inclusiva.

5. Transparência

As soluções habilitadas para IA exigem a divulgação sobre quais funções e recursos são habilitados para IA, o processo de validação e a responsabilidade pela tomada de decisão definitiva. Como quinto e último princípio, a confiança pública e a adoção mais ampla da IA na área da saúde dependerão, em última instância, da transparência. Sempre que a IA é aplicada em uma solução, precisamos ser transparentes e divulgar como ela foi validada, quais conjuntos de dados foram usados e quais foram os resultados relevantes. Deve-se também esclarecer o papel do profissional de saúde na tomada de uma decisão final. Mas, talvez o mais importante, a transparência ideal pode ser alcançada por meio do desenvolvimento em parceria de soluções habilitadas para IA. Ao forjar uma estreita colaboração entre diferentes atores do sistema de saúde – profissionais, fontes pagadoras, pacientes, pesquisadores, reguladores – podemos, conjuntamente, descobrir e atender às diversas necessidades, demandas e preocupações que devem ser levadas em consideração no desenvolvimento de soluções habilitadas para IA. Não como uma reflexão posterior, mas desde o início, como parte de um diálogo aberto e esclarecido.

Vamos moldar o futuro da IA na saúde juntos

Juntos, acredito que esses cinco princípios podem ajudar a pavimentar o caminho para o uso responsável da IA em aplicações de saúde e saúde pessoal. No entanto, também percebo que nenhum de nós tem todas as respostas. Novas perguntas surgirão à medida que continuarmos neste emocionante caminho de descoberta e inovação com a IA, e estou ansioso para discuti-las com todos. Leia mais sobre os Princípios de IA da Philips Referências [1] Guo J, Li B. The Application of Medical Artificial Intelligence Technology in Rural Areas of Developing Countries. Health Equity. 2018;2(1):174–181. [2] Cooper G, Aliferis C, Ambrosino R, et al. An evaluation of machine-learning methods for predicting pneumonia mortality. Artificial Intelligence in Medicine. 1997;9(2):107–138. [3] Perdoncin E, Duvernoy C. Treatment of Coronary Artery Disease in Women. Cardiovasc J. 2017;13(4):201–208. [4] Prabhakaran D, Jeemon P, Roy A. Cardiovascular Diseases in India: Current Epidemiology and Future Directions. Circulation. 2016;133(16):1605-20

Compartilhe nas redes sociais

Tópicos

Autor

Henk van Houten

Former Chief Technology Officer at Royal Philips from 2016 to 2022